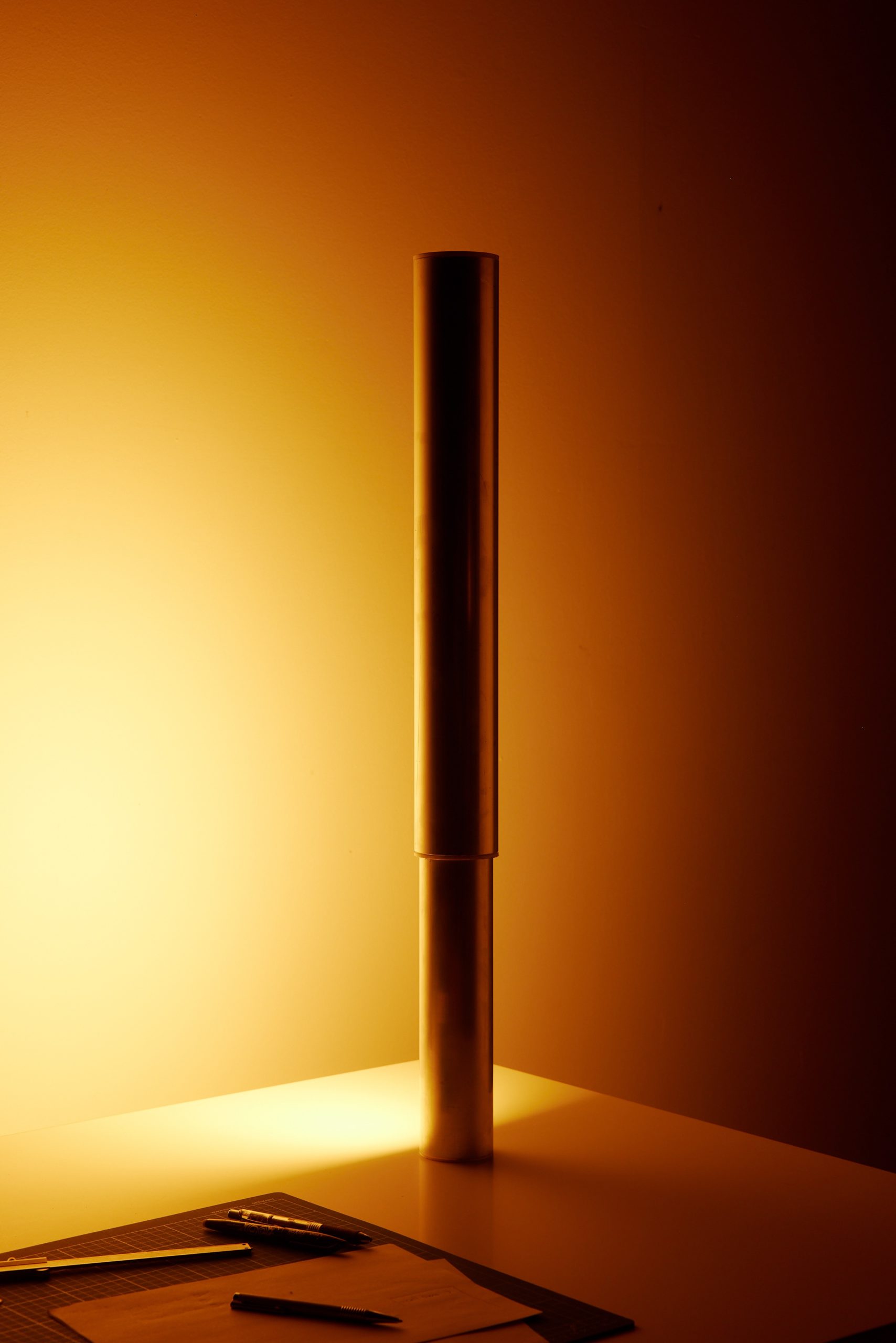

„Der Trog“ ist ein kontaktloses Atem-zu-Wasser-Interface, das mithilfe von Computer Vision den Atem trackt. Die:der Nutzer:in nähert sich einem mit Wasser gefüllten Objekt, nimmt auf einem Stuhl Platz und beginnt zu atmen: Das Wasser reagiert mit einer wellenförmigen Bewegung. Eine Thermalkamera neben dem Objekt erkennt dabei kleine Temperaturunterschiede auf der Haut der*des Nutzer*in und leitet daraus kontaktlos Atemrhythmus und -intensität ab.

“Der Trog“ ist eine Haltung zur ganzheitlichen Anwendung von Computertechnologie. Wie fügt sich kontaktlose Sensorik, durch die der Körper jederzeit erreich- und übersetzbar ist, in eine Zukunft ein, in der digital und physisch nicht mehr abzugrenzen sind? Wie verändert sich die Wahrnehmung unserer Umgebung, wenn wir eine verkörperte Verbindung zu Material und Objekt herstellen können? Wie kann AI die Interaktion zwischen Mensch zu Maschine und Mensch zu Mensch erweitern?